Una ejecutiva de Meta que estaba sentada en el estrado de un pequeño tribunal en Londres la semana pasada, se enfrentó a una pregunta incómoda: ¿acaso su compañía había contribuido al suicidio de una joven de 14 años llamada Molly Russell?

Los videos e imágenes de suicidios, contenido depresivo y de autolesiones que la adolescente vio en los meses antes de su muerte en noviembre de 2017 se mostraron en una pantalla en el tribunal. A la ejecutiva se le leyó una publicación de Instagram a la que Molly le había dado me gusta o había guardado, y luego escuchó cómo esta fue copiada casi palabra por palabra en una nota llena de autodesprecio que sus papás encontraron.

“Aquí vemos cómo Instagram literalmente mete ideas a la mente de Molly”, dijo enfurecido Oliver Sanders, un abogado que representa a la familia, mientras interrogaba a la testigo.

La ejecutiva, Elizabeth Lagone, encargada de las políticas de salud y bienestar de la empresa, se inclinó hacia adelante y respondió: “Yo no sé qué es lo que pasaba por la mente de Molly”.

El forense que supervisa el caso, que en el Reino Unido es una figura de tipo judicial con una autoridad amplia para investigar y determinar de manera oficial la causa de muerte de una persona, fue mucho menos circunspecto. El viernes, dictaminó que Instagram y otras plataformas de redes sociales habían contribuido a su muerte, quizá la primera vez que se culpa legalmente a las empresas de internet por un suicidio.

“Molly Rose Russell murió a causa de un acto de autolesión como consecuencia de la depresión y los efectos negativos del contenido en línea”, afirmó el forense Andrew Walker. En lugar de clasificar oficialmente su muerte como un suicidio, declaró que internet “afectó su salud mental de una manera negativa y contribuyó a su muerte de una manera que no es mínima”.

La sentencia, de carácter imparcial y declarativo, puso fin a una batalla legal que enfrentó a la familia Russell con algunas de las empresas más grandes de Silicon Valley. Al profundizar en los peores temores de muchos padres sobre la influencia del internet y las redes sociales en sus hijos, el caso resonó en todo el Reino Unido y más allá. Una multitud de cámaras de televisión y fotógrafos se reunió afuera del tribunal cuando se anunció la decisión.

Durante la investigación se dieron a conocer miles de imágenes, videos y otro material de redes sociales de las cuentas de Molly, una de las mayores divulgaciones públicas de este tipo. Esto proporcionó el tipo de detalles que durante mucho tiempo los investigadores que estudian los efectos de las redes sociales en la salud mental han acusado a las plataformas como Meta, propietaria de Facebook e Instagram, de retener por motivos de privacidad y ética.

En el historial de Molly en redes sociales había material tan perturbador que un trabajador del tribunal se salió de la sala para evitar ver una serie de videos de Instagram que mostraban un suicidio. Un psicólogo infantil que fue llamado como testigo experto aseveró que el material era tan “perturbador” y “angustiante” que le provocó insomnio durante semanas.

Las compañías no enfrentarán ninguna sanción económica o de otro tipo por la decisión. El caso era una investigación forense para determinar la causa de muerte, no un juicio penal o civil. La familia dijo que había llevado el caso a los tribunales como una forma de justicia para Molly y para sensibilizar a la gente sobre el suicidio entre los jóvenes y los peligros de las redes sociales.

Meta, que reconoció durante la investigación que nunca había estudiado los efectos del contenido suicida y depresivo de Instagram en sus usuarios más jóvenes, declaró en un comunicado posterior que sus “pensamientos están con la familia Russell” y que estaba “comprometida a garantizar que Instagram sea una experiencia positiva para todos, especialmente para los adolescentes”.

“Pines de depresión que quizás te gusten”

La familia Russell tenía una vida “casi aburrida” en un suburbio al norte de Londres, contó Ian Russell, el padre de Molly, en una entrevista en julio antes de la investigación. Preocupados por cómo sus tres hijas usaban la tecnología, él y su esposa, Janet, asistieron a un curso de seguridad electrónica en la escuela de las niñas e intentaban estar al tanto de sus cuentas de redes sociales. No tenían permiso de usar sus teléfonos mientras comían.

A Molly, como a sus dos hermanas mayores, le dieron un teléfono básico a los 11 años, cuando muchos niños en el Reino Unido empiezan a irse solos a la escuela. Recibió un iPhone de regalo cuando cumplió 13 años, y al poco tiempo creó una cuenta de Instagram con el permiso de sus padres.

Molly, que había disfrutado de la equitación y la música pop, comenzó a pasar más tiempo en su habitación, pero nada despertó alarmas. Russell relató que la menor pocas veces publicaba algo en las redes sociales, pero no era raro encontrarla sentada en su cama viendo Netflix en un iPod Touch mientras se mensajeaba con sus amigos en otro dispositivo.

La noche antes de su muerte, la familia vio junta un programa de telerrealidad, y Molly le pidió a Russell que la ayudara con un proyecto que tenía que ver con experiencia laboral. Estaba emocionada porque tenían boletos para ver “Hamilton” e iba a ser una de las protagonistas en una obra de teatro que iban a hacer en la escuela.

Fue solo cuando Russell se sentó a examinar la computadora de la familia que el rompecabezas comenzó a armarse. Después de que logró entrar a la cuenta de Instagram de Molly, encontró una carpeta titulada “Cosas sin importancia”, con decenas de citas e imágenes preocupantes. “¿Quién podría amar a una chica suicida?”, rezaba una.

Se quedó boquiabierto al revisar la bandeja de entrada del correo electrónico de Molly, donde encontró una nota de Pinterest que llegó unas dos semanas después de su muerte. “Pines de depresión que quizá te gusten”, decía.

En enero de 2019, Russell hizo pública la historia de Molly. Indignado de que su joven hija pudiera ver un contenido tan sombrío con tanta facilidad y convencido de que todo esto había contribuido a su muerte, se sentó para una entrevista de televisión con la BBC que dio lugar a artículos de primera plana en los rotativos británicos.

La doble vida de Molly

Russell, director de televisión, instó al forense que revisaba el caso de Molly a que fuera más allá del proceso, a menudo formulista, y explorara el papel de las redes sociales. Walker estuvo de acuerdo tras dar un vistazo al historial de redes sociales de Molly.

El resultado fue un esfuerzo de años para acceder a los datos de las redes sociales de Molly. La familia no conocía el código de acceso de su iPhone, pero la policía londinense pudo sortearlo para extraer 30.000 páginas de material. Tras una larga batalla, Meta accedió a proporcionar más de 16.000 páginas de su Instagram, un volumen tan grande que retrasó el inicio de las pesquisas. Merry Varney, una abogada del bufete Leigh Day que trabajó en el caso a través de un programa de asistencia jurídica, dijo que le había tomado más de 1000 horas revisar el contenido.

Lo que descubrieron fue que Molly había vivido una especie de doble vida. Mientras que para su familia, amigos y profesores era una adolescente normal, su existencia en internet era mucho más lúgubre.

En los seis meses anteriores a su muerte, Molly compartió, le dio me gusta o guardó 16.300 contenidos en Instagram. Alrededor de 2100 de esas publicaciones, o unas 12 al día, tenían que ver con el suicidio, las autolesiones y la depresión, según los datos que Meta reveló a la familia. Muchas de las cuentas con las que interactuaba se dedicaban a compartir únicamente material depresivo y suicida; a menudo usaban etiquetas que enlazaban a otros contenidos explícitos.

Meta reconoció que Molly había visto cierto contenido que violaba sus políticas, pero defendió sus prácticas en general como un equilibrio entre la libre expresión y la seguridad. Después de que la familia hiciera pública la experiencia de Molly en 2019, la empresa añadió nuevas protecciones, incluyendo la prohibición de imágenes gráficas de autolesiones, como cortarse, y la provisión de enlaces a recursos para quienes vean material triste o depresivo.

Lagone, que tiene experiencia en salud pública y fue contratada por Meta en 2020, declaró que, aunque lamentaba que Molly hubiera visto un contenido tan angustioso, era importante dar a la gente un espacio donde expresar su tristeza abiertamente, como “un grito de ayuda”.

Después de que se anunciara la decisión final del caso el viernes, Russell seguía dándole vueltas a un comentario que hizo Lagone durante su testimonio de que parte del material que Molly había visto era seguro.

“Si este sendero demente de contenido que te succiona la vida fuera seguro”, afirmó, “mi hija Molly tal vez seguiría viva”.

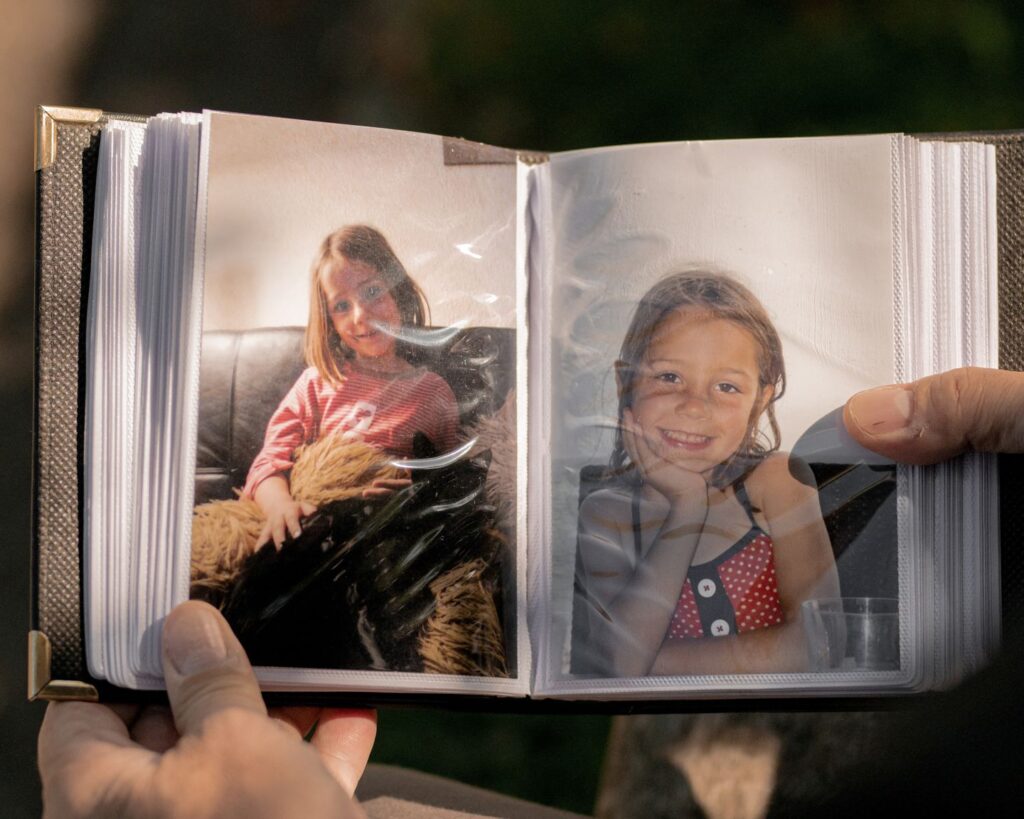

Ian Russell con un álbum de fotos de su hija Molly Russell, una adolescente que murió por suicidio en noviembre de 2017, cerca de su casa en Harrow, en el noroeste de Londres, el 17 de septiembre de 2022. (Jonathan Clifford/The New York Times).

Ian Russell sostiene un álbum de fotos de su hija Molly Russell, una adolescente que murió por suicidio en noviembre de 2017, cerca de su casa en Harrow, en el noroeste de Londres, el 17 de septiembre de 2022. (Jonathan Clifford/The New York Times).

Recomendados

Mercado Libre despidió a más de 100 trabajadores en la región ¿Serán reemplazados por IA?

Estos son los robots humanoides que acaparan la atención en CES 2026

Peligros de compartir el código de verificación de WhatsApp: robo de cuenta, suplantación y más